Стивен Хокинг рассказал о плюсах и минусах изобретения искусственного интеллекта

Стивен Хокинг рассказал о плюсах и минусах изобретения искусственного интеллекта

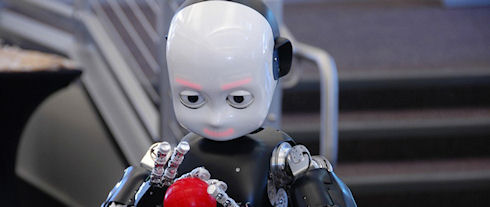

Знаменитый ученый Стивен Хокинг выступил с предостережением, призвав отказаться от разработки искусственного интеллекта, который может стать одновременно самым великим и опасным изобретением человеческой цивилизации. Хокинг считает, что это событие может ознаменовать начало конца эпохи людей на планете Земля. Пока не поздно, Хокинг призывает оценить риски, связанные с возможностью скорого появления искусственного интеллекта, чтобы выработать план действий на случай возможных неожиданностей.

Знаменитый ученый Стивен Хокинг выступил с предостережением, призвав отказаться от разработки искусственного интеллекта, который может стать одновременно самым великим и опасным изобретением человеческой цивилизации. Хокинг считает, что это событие может ознаменовать начало конца эпохи людей на планете Земля. Пока не поздно, Хокинг призывает оценить риски, связанные с возможностью скорого появления искусственного интеллекта, чтобы выработать план действий на случай возможных неожиданностей.

Очевидно, что главная опасность таится в возможности использовать это изобретение в военных целях, что, несомненно, очень опасно. При этом, не менее очевидна и выгода, которую может принести искусственный интеллект, взяв на себя огромное количество задач и обеспечив появление и эффективное применение новых технологий в самых разных областях жизнедеятельности человека.

Хокинг резюмировал, что в результате все сведется к тому, кто же будет контролировать искусственный интеллект и какие цели будет преследовать. Впрочем, если учесть заложенный в него потенциал самосовершенствования и обучения, то со временем человек может не справиться со своим детищем, причем защиту от него невозможно будет обеспечить в принципе.

Читайте также

- Xiaomi представила маршрутизатор Redmi Router AX5400 с чипом Qualcomm

- Western Digital повысила цены на флеш-память NAND — это следствие загрязнения производства в январе

- 4 вида вооружения, которые отправили в Европу из-за Украины, но никогда не испытывали в деле

- Twitter позволит вешать ярлыки на ботов, чтобы люди могли отличать их от живых пользователей

- Найдена загадочная "невидимая" черная дыра: космическая аномалия

- Новая статья: Обзор игрового 4K-монитора ASUS TUF Gaming VG28UQL1A: лучше поздно, чем никогда